In den letzten Monaten habe ich viele Workshops zu Generativer KI gegeben. Hier die 3 größten Irrtümer, die mir immer wieder begegnen. Sie stehen deinem effektiven Arbeiten mit KI im Weg – denn wenn du die KI nicht verstehst – wie soll sie dich verstehen? Und nichts ist frustiger, als Computer, die nicht tun, was sie sollen, oder?

NEU: Diesen Blog-Beitrag als automatisch erstellten KI-Podcast (NotebookLM) im Dialog hören. Für unterwegs 🙂

Irrtum 1:

Die KI erinnert sich an Informationen

Du denkst, dass generative KI sich an Informationen erinnert, mit denen sie während des Trainings gefüttert wurde? Falsch gedacht 😉 Denn: Die KI speichert während des Trainings keine spezifischen Fakten oder Texte wie ein Lexikon. Stattdessen lernt sie Muster und Zusammenhänge. Wenn du sie fragst, generiert sie Antworten basierend auf diesen gelernten Mustern und Wahrscheinlichkeiten. Sie hat also kein echtes “Gedächtnis” im menschlichen Sinne, sondern “nur” ein tiefes Verständnis für Sprache und Konzepte basierend auf Wahrscheinlichkeiten.

Beispiel: Stell dir die Wortvervollständigung vor, die du von deinem Smartphone kennst. Ähnlich wie dein Handy versucht, das nächste Wort zu erraten, basierend auf dem, was du bisher getippt hast, „rät“ die generative KI die wahrscheinlichste Fortführung eines Textes oder einer Konversation. Sie nutzt dabei die Muster, die sie in ihren Trainingsdaten erkannt hat.

Das erklärt auch die sogenannten “Halluzinationen”. Das sind Antworten der KI, die zwar auf Basis ihrer Muster wahrscheinlich sind – aber eben nicht mit der Realität übereinstimmen.

Was das für dich bedeutet: Verlass dich nicht blind darauf, dass die KI dir exakte Fakten oder Zitate liefert, auch wenn diese wahrscheinlich richtig klingen. Checke wichtige Informationen immer nochmal in zuverlässigen Quellen.

Irrtum 2:

Die KI sucht Informationen im Internet

Noch ein Irrtum: Viele denken, die KI würde ständig vom Internet trainiert. Tatsächlich werden die Large Language Models (LLMs) mit Datensätzen aus dem Internet trainiert. Und diese Daten haben ein Enddatum. Einige Modelle (Gemini, Perplexity, Claude, ChatGPT 4o) können zusätzlich wie eine Suchmaschine im Internet recherchieren, aber z.B. GPT 3.5 kann das nicht. Es beantwortet Fragen nur aus seinen Daten, die übrigens bereits im September 2021 enden. Und auch Modelle, die recherchieren können, tun das nicht immer, sondern beantworten sehr viel auch erstmal nur auf Basis ihrer Trainingsdaten.

Was das für dich bedeutet:

- Sei dir bewusst, dass die KI möglicherweise nicht über aktuelle Ereignisse Bescheid weiß. Check den Wissensstand des Modells, mit dem du arbeitest: Wie alt sind die Daten, auf die das Modell zurückgreift?

- Für aktuelle Informationen nutze KI-Modelle, die Zugang zum Internet haben.

- Sei vorsichtig bei Fragen zu zeitkritischen Themen wie Gesetzen, Technologien oder aktuellen Ereignissen. Die Antworten könnten veraltet sein.

- Nutze die KI als Ausgangspunkt für Ideen und Recherchen, aber überprüfe wichtige Fakten immer in aktuellen, vertrauenswürdigen Quellen.

Irrtum 3:

Du trainierst die KI, wenn du mit ihr chattest

Viele glauben, dass sie die KI trainieren, während sie mit ihr chatten. Aber das stimmt so nicht. Tatsächlich ändert sich am Modell selbst gar nichts, während du mit ihm chattest. Dennoch hast du beim Chatten wahrscheinlich das Gefühl, dass die KI sich meistens an deine früheren Angaben „erinnert“ und einen flüssigen Gesprächsverlauf aufrechterhält. Aber die KI lernt dabei nicht wirklich aus deinen Eingaben. Stattdessen schickt sie sich selbst mit jeder deiner Eingaben den ganzen früheren Gesprächsverlauf zurück. So hat sie mit jedem Prompt innerhalb eines Chats mehr Kontext und kann dir besser antworten. An andere Chats mit dir kann sie sich nicht erinnern.

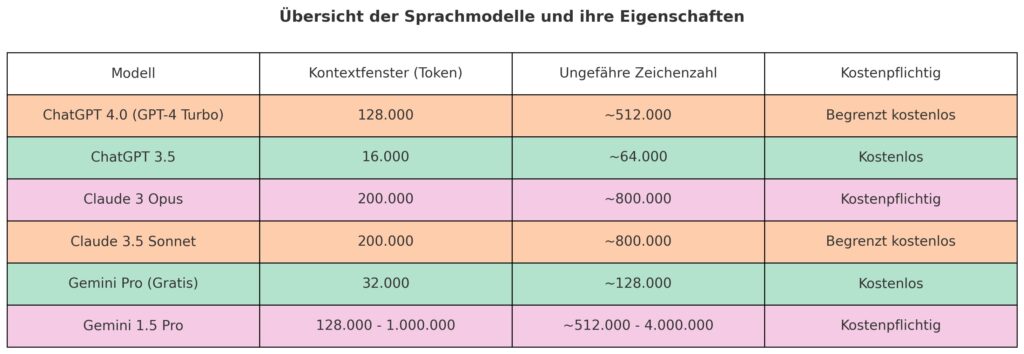

Dieses Zurücksenden ist das Kontext-Fenster. Es funktioniert quasi wie ein Kurzzeitgedächtnis für den Chatverlauf. ABER: Sobald der Chat (oder geteilte Dokumente z.B Studien) eine bestimmte Länge überschreitet, fallen ältere Teile aus diesem Fenster heraus und werden nicht mehr berücksichtigt. Die KI hat einfach eine begrenzte Kapazität für den Kontext, den sie gleichzeitig verarbeiten kann. Für dich fühlt sich das wie ein “Vergessen” an.

Das Kontext-Fenster ist abhängig vom Modell, mit dem du arbeitest. ChatGPT hat eher kurze Kontext-Fenster, Claude große, bei Gemini kommt es sehr auf die Version an. Leider gibt es auch keine Fehlermeldung, wenn das Kontext-Fenster sich schließt.

Zurück zum Training der KI mit deinen Daten

Die Daten, die du mit der KI teilst, werden beim Anbieter gespeichert. Dieser wertet sie in der Regel aus, um zu sehen, wie wir die KI nutzen UND diese Daten können auch für das Training des nächsten Modells genutzt werden. Bei ChatGPT kannst du diesem Training in den Datenschutzeinstellungen widersprechen. Bei anderen Modellen habe ich noch keine solche Einstellung gefunden. (Hinweise bitte gern an mich!)

Was das für dich bedeutet:

- Geh davon aus, dass jede Interaktion mit der KI neu anfängt. Wenn du auf frühere Informationen zurückgreifen willst, musst du sie nochmal erwähnen

- Starte für neue Aufgaben neue Chats.

- Gib zu Beginn jedes Chats den Kontext zu deiner Arbeit erneut ein (oder hinterlege ihn in den Custom Instructions).

- Wenn du an langen Texten arbeitest, unterteile sie ggf. in Kapitel und starte jeweils eigene Chats dazu.

- Gib keine personenbezogenen oder sensiblen Daten ein.

Fazit: Welchen Irrtum hattest du? Wie hat er deiner Nutzung im Weg gestanden? Was willst und kannst du jetzt besser ausprobieren? Neben Verstehen ist Ausprobieren nämlich der beste Weg, gute Anwendungen für KI für deinen Arbeitsalltag zu finden! Viel Erfolg und Spaß dabei!